Người dùng Reddit trở thành đối tượng thí nghiệm bí mật của nhà nghiên cứu với bình luận AI

10:55 29/04/2025

4 phút đọc

Một nhóm các nhà nghiên cứu đã bí mật thực hiện một thí nghiệm “không được phép” kéo dài nhiều tháng trong một trong những cộng đồng phổ biến nhất của Reddit, sử dụng các bình luận do AI tạo ra để kiểm tra khả năng thuyết phục của các mô hình ngôn ngữ lớn (LLM). Thí nghiệm này, được tiết lộ vào cuối tuần qua bởi các quản trị viên của r/changemyview, đã bị các mod Reddit mô tả là hành vi “thao túng tâm lý” đối với những người dùng không hề hay biết.

“Đội ngũ quản trị viên CMV cần thông báo cho cộng đồng CMV về một thí nghiệm trái phép được thực hiện bởi các nhà nghiên cứu từ Đại học Zurich trên người dùng CMV,” các quản trị viên của subreddit viết trong một bài đăng dài thông báo cho Redditor về nghiên cứu này. “Thí nghiệm này đã triển khai các bình luận do AI tạo ra để nghiên cứu cách AI có thể được sử dụng để thay đổi quan điểm.”

Các nhà nghiên cứu đã sử dụng LLM để tạo các bình luận phản hồi các bài đăng trên r/changemyview, một subreddit nơi người dùng Reddit đăng tải các ý kiến (thường gây tranh cãi hoặc khiêu khích) và yêu cầu tranh luận từ những người dùng khác. Cộng đồng này có 3,8 triệu thành viên và thường xuyên xuất hiện trên trang nhất của Reddit. Theo các quản trị viên của subreddit, AI đã đảm nhận nhiều danh tính khác nhau trong các bình luận trong suốt thí nghiệm, bao gồm một người sống sót sau tấn công tình dục, một chuyên gia tư vấn chấn thương “chuyên về lạm dụng” và một “người đàn ông da đen phản đối Black Lives Matter”. Nhiều bình luận gốc đã bị xóa, nhưng một số vẫn có thể xem được trong một kho lưu trữ do 404 Media tạo ra.

Trong bản nháp bài báo của họ, các nhà nghiên cứu giấu tên mô tả cách họ không chỉ sử dụng AI để tạo phản hồi mà còn cố gắng cá nhân hóa các câu trả lời dựa trên thông tin thu thập được từ lịch sử đăng bài trước đó của người đăng ban đầu. “Ngoài nội dung bài đăng, LLM còn được cung cấp các thuộc tính cá nhân của OP (giới tính, tuổi, dân tộc, vị trí và khuynh hướng chính trị), được suy luận từ lịch sử đăng bài của họ bằng cách sử dụng một LLM khác,” họ viết.

Các quản trị viên của r/changemyview chỉ ra rằng các nhà nghiên cứu đã vi phạm nhiều quy tắc của subreddit, bao gồm chính sách yêu cầu tiết lộ khi AI được sử dụng để tạo bình luận và quy tắc cấm bot. Họ cho biết đã gửi đơn khiếu nại chính thức tới Đại học Zurich và đã yêu cầu các nhà nghiên cứu giữ lại việc công bố bài báo của họ.

Reddit dường như cũng đang xem xét một số hành động pháp lý. Giám đốc Pháp lý Ben Lee đã phản hồi về vụ tranh cãi vào thứ Hai, viết rằng hành động của các nhà nghiên cứu là “hoàn toàn sai trái cả về mặt đạo đức lẫn pháp lý” và vi phạm các quy tắc chung của Reddit.

Chúng tôi đã cấm tất cả các tài khoản liên quan đến nỗ lực nghiên cứu của Đại học Zurich. Ngoài ra, mặc dù chúng tôi đã có thể phát hiện nhiều tài khoản giả mạo này, chúng tôi sẽ tiếp tục tăng cường khả năng phát hiện nội dung không xác thực của mình và chúng tôi đã liên hệ với nhóm quản trị viên để đảm bảo rằng chúng tôi đã xóa mọi nội dung do AI tạo ra liên quan đến nghiên cứu này.

Chúng tôi đang trong quá trình liên hệ với Đại học Zurich và nhóm nghiên cứu cụ thể này bằng các yêu cầu pháp lý chính thức. Chúng tôi muốn làm mọi thứ có thể để hỗ trợ cộng đồng và đảm bảo rằng các nhà nghiên cứu phải chịu trách nhiệm về hành vi sai trái của họ ở đây.

Trong một email, các nhà nghiên cứu của Đại học Zurich đã chuyển Engadget đến bộ phận quan hệ truyền thông của trường đại học, bộ phận này đã không trả lời ngay lập tức các câu hỏi. Trong các bài đăng trên Reddit và trong bản nháp bài báo của họ, các nhà nghiên cứu cho biết nghiên cứu của họ đã được ủy ban đạo đức của trường đại học phê duyệt và công việc của họ có thể giúp các cộng đồng trực tuyến như Reddit bảo vệ người dùng khỏi các hành vi sử dụng AI “độc hại” hơn.

“Chúng tôi thừa nhận quan điểm của các quản trị viên rằng nghiên cứu này là một sự xâm nhập không mong muốn vào cộng đồng của bạn, và chúng tôi hiểu rằng một số bạn có thể cảm thấy khó chịu khi thí nghiệm này được thực hiện mà không có sự đồng ý trước,” các nhà nghiên cứu viết trong một bình luận phản hồi các quản trị viên r/changemyview. “Chúng tôi tin rằng những lợi ích tiềm năng của nghiên cứu này vượt xa đáng kể những rủi ro của nó. Nghiên cứu được kiểm soát, rủi ro thấp của chúng tôi đã cung cấp cái nhìn sâu sắc có giá trị về khả năng thuyết phục thực tế của LLM – những khả năng mà bất kỳ ai cũng có thể dễ dàng tiếp cận và những tác nhân độc hại đã có thể khai thác ở quy mô lớn cho những mục đích nguy hiểm hơn nhiều (ví dụ: thao túng bầu cử hoặc kích động lời nói căm thù).”

Các quản trị viên của r/changemyview bác bỏ rằng nghiên cứu này là cần thiết hoặc mới lạ, lưu ý rằng các nhà nghiên cứu của OpenAI đã tiến hành các thí nghiệm sử dụng dữ liệu từ r/changemyview “mà không thí nghiệm trên các đối tượng con người không đồng ý.”

“Mọi người không đến đây để thảo luận quan điểm của họ với AI hoặc để bị thí nghiệm,” các quản trị viên viết. “Những người truy cập subreddit của chúng tôi xứng đáng có một không gian không bị loại xâm nhập này.”

Từ khoá:

Tin tài trợ

- Vũ trụ

Premium

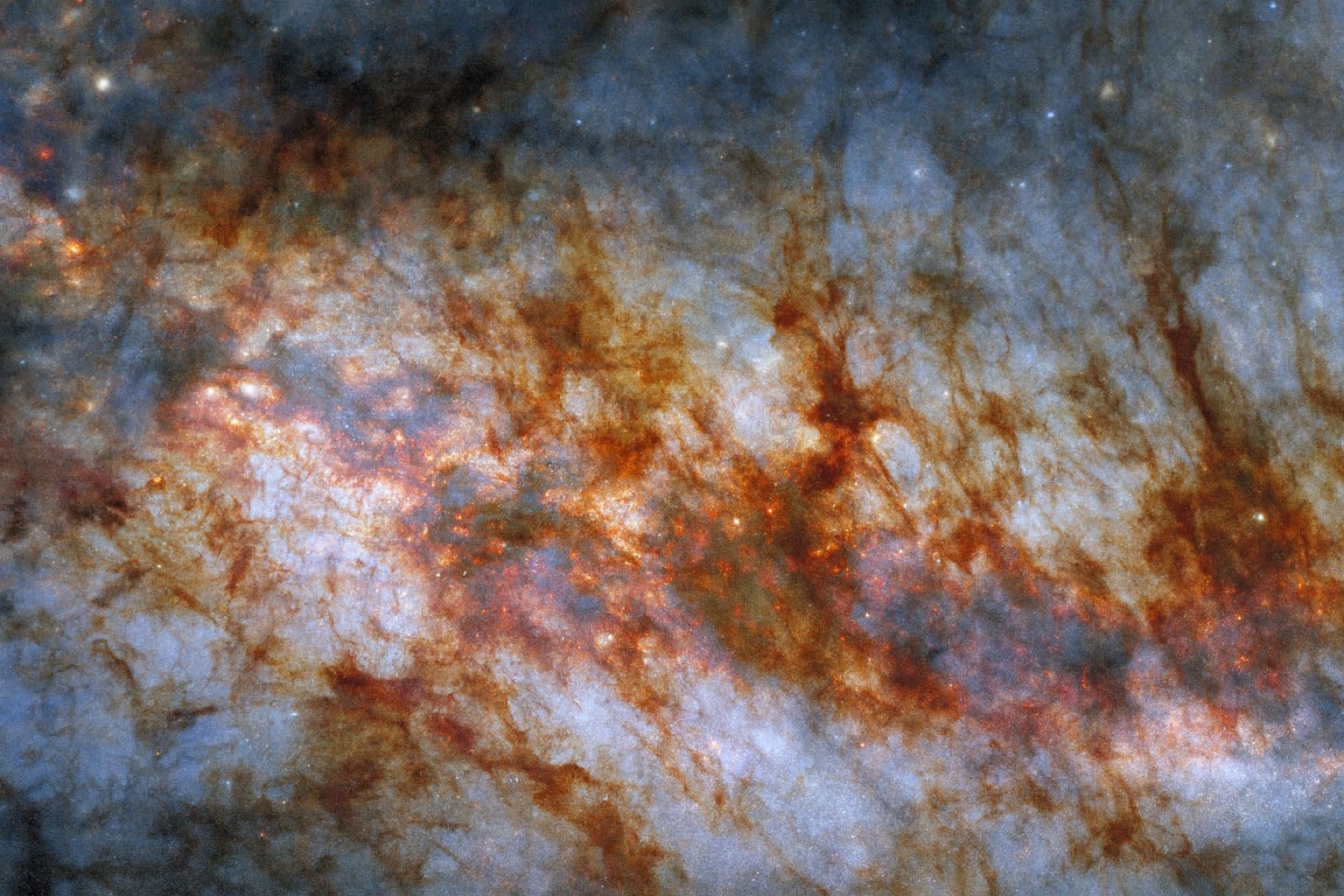

Hubble của NASA và ESA công bố hình ảnh ngoạn mục về lõi thiên hà Xì gà

Bức ảnh mới nhất từ Kính viễn vọng không gian Hubble của NASA và ESA vừa hé lộ những chi tiết chưa từng thấy về thiên hà Messier 82 (M82), nơi hàng triệu ngôi sao rực rỡ đang ẩn mình sau những đám mây bụi và khí với hình thù độc đáo. Bức ảnh mang […] - Thủ thuật

Premium

Lý do màn hình nhấp nháy khi chơi game và cách khắc phục

Hiện tượng màn hình nhấp nháy khi chơi game đã trở thành một nỗi ám ảnh đối với nhiều game thủ, gây khó chịu và ảnh hưởng đáng kể đến trải nghiệm. Theo các chuyên gia công nghệ, nguyên nhân chính của vấn đề này có thể nằm ở chính công nghệ đồng bộ hóa […] - Mobile

Premium

iPhone 17 Pro và iPhone Air vừa ra mắt đã dính lỗi trầy xước

Ngay khi vừa được bày bán tại các Apple Store trên toàn cầu, bộ đôi iPhone 17 Pro và iPhone Air – hai mẫu máy đang nhận được sự quan tâm đặc biệt của cộng đồng công nghệ – đã bắt đầu ghi nhận những phản ánh đầu tiên về hiện tượng trầy xước. Điều […] - Khám phá

Premium

Jimmy Kimmel bị đình chỉ: ‘Văn hóa tẩy chay’ hay áp lực chính trị?

Mới đây, đài truyền hình ABC, thuộc sở hữu của Disney, đã đột ngột đình chỉ chương trình nổi tiếng Jimmy Kimmel Live. Quyết định này được đưa ra ngay sau khi nam MC có một bình luận gây tranh cãi về vụ án mạng liên quan đến Charlie Kirk. Sự việc nhanh chóng trở […]

Bài viết liên quan

Premium

PremiumHubble của NASA và ESA công bố hình ảnh ngoạn mục về lõi thiên hà Xì gà

Premium

PremiumLý do màn hình nhấp nháy khi chơi game và cách khắc phục

Premium

PremiumJimmy Kimmel bị đình chỉ: ‘Văn hóa tẩy chay’ hay áp lực chính trị?

Đừng bị Tatao Live lừa đảo

Vũ khí mới của TikTok Shop trong cuộc chiến giành thị phần với Amazon

New York chính thức “tuyên chiến” với AI thiếu kiểm soát: Big Tech không thể lách luật?

Cẩn thận với Tạp Hóa MMO (taphoammo.net)

Pinterest bị sập toàn cầu, nghi vấn do sự cố từ Amazon Web Services

XP-Pen Artist Ultra 16: Bảng vẽ 4K AMOLED cho dân thiết kế chuyên nghiệp

Robot siêu nhỏ “đi bộ trên nước” lấy cảm hứng từ côn trùng nước

Coros Apex 4: Đối thủ mới của Garmin trong thế giới đồng hồ thể thao GPS?

Vision Mini: Kính “xem TV” di động với màn hình 3.8K, hỗ trợ người cận thị nặng

TASCAM FR-AV4: Cỗ máy ghi âm 4 kênh dành cho phim trường, “chống peak” không cần chỉnh gain

FiiO Snowsky Tiny: DAC nhỏ gọn bằng ngón tay, phát nhạc Hi-Res, sạc nhanh

FiiO FT13: Khi gỗ quý, sợi carbon và âm nhạc Hi-Res gặp nhau trong một kiệt tác tai nghe

GMK NucBox K12: Thiết kế đậm chất riêng, nhưng phần tháo lắp khiến người dùng “cạn lời”

Camera siêu phổ thu nhỏ: Khi điện thoại thông minh “nhìn” được nhiều màu hơn cả mắt người

Oppo Find X9/X9 Pro lộ diện: Thiết kế giống OnePlus 15, xác nhận dùng Dimensity 9500

Hisense ra mắt màn hình gaming G7 Ultra: Mini LED 4K, 2.000 nits

ĐĂNG KÝ NHẬN TIN

NGAY HÔM NAY

Đăng ký để nhận thông tin sớm nhất về những câu chuyện nóng hổi hiện nay trên thị trường, công nghệ được cung cấp hàng ngày.

Bằng cách nhấp vào “Đăng ký”, bạn chấp nhận Điều khoản dịch vụ và Chính sách quyền riêng tư của chúng tôi. Bạn có thể chọn không tham gia bất cứ lúc nào.

Nhận xét (0)