Tranh cãi về tính minh bạch của Ủy ban an toàn mới do OpenAI thành lập

01:34 29/05/2024

4 phút đọc

Công ty trí tuệ nhân tạo OpenAI vừa thành lập một ủy ban mới để giám sát các vấn đề an toàn và bảo mật “quan trọng” liên quan đến các dự án và hoạt động của công ty. Tuy nhiên, động thái này có thể khiến các chuyên gia đạo đức công nghệ phật ý vì OpenAI đã chọn những người trong công ty – bao gồm cả CEO Sam Altman – tham gia ủy ban thay vì các chuyên gia độc lập bên ngoài.

Ủy ban An toàn và Bảo mật bao gồm các thành viên hội đồng quản trị OpenAI là Bret Taylor, Adam D’Angelo và Nicole Seligman, cùng với Giám đốc khoa học Jakub Pachocki, Trưởng nhóm Sẵn sàng Aleksander Madry, Trưởng nhóm Hệ thống An toàn Lilian Weng, Trưởng nhóm Bảo mật Matt Knight và Trưởng nhóm Khoa học Điều hướng John Schulman. Theo bài đăng trên blog của công ty, họ sẽ chịu trách nhiệm đánh giá các quy trình và biện pháp an toàn của OpenAI trong 90 ngày tới. Sau đó, ủy ban sẽ chia sẻ kết quả và đề xuất với toàn thể hội đồng quản trị OpenAI để xem xét. OpenAI cho biết họ sẽ công bố cập nhật về bất kỳ đề xuất nào được áp dụng “theo cách phù hợp với an toàn và bảo mật”.

OpenAI đang phát triển mô hình trí tuệ nhân tạo tiên tiến tiếp theo và tin rằng các hệ thống này sẽ đưa họ lên một tầm cao mới về năng lực trên con đường hướng tới trí tuệ tổng hợp nhân tạo (AGI). Mặc dù tự hào về việc xây dựng và phát hành các mô hình dẫn đầu ngành về cả khả năng và tính an toàn, OpenAI vẫn hoan nghê迎 (yíng) đón những tranh luận mạnh mẽ vào thời điểm quan trọng này.

Trong vài tháng qua, OpenAI đã chứng kiến một số nhân sự cấp cao rời khỏi mảng an toàn trong nhóm kỹ thuật của mình – và một số cựu nhân viên này đã lên tiếng bày tỏ lo ngại về việc họ cho là công ty đang cố tình giảm ưu tiên cho vấn đề an toàn AI.

Nhà nghiên cứu chính sách AI Gretchen Krueger, người vừa rời OpenAI, đồng tình với tuyên bố của Leike, kêu gọi công ty cải thiện tính trách nhiệm và minh bạch, đồng thời “cẩn trọng hơn trong việc sử dụng công nghệ của chính mình”.

I resigned a few hours before hearing the news about @ilyasut and @janleike, and I made my decision independently. I share their concerns. I also have additional and overlapping concerns.

— Gretchen Krueger (@GretchenMarina) May 22, 2024

Quartz lưu ý rằng, bên cạnh Sutskever, Kokotajlo, Leike và Krueger, ít nhất năm nhân viên quan tâm đến an toàn hàng đầu của OpenAI đã nghỉ việc hoặc bị buộc thôi việc kể từ cuối năm ngoái, bao gồm cả các cựu thành viên hội đồng quản trị OpenAI là Helen Toner và Tasha McCauley. Trong một bài đăng trên The Economist được xuất bản Chủ nhật, Toner và McCauley viết rằng – với Altman làm lãnh đạo – họ không tin OpenAI có thể tự chịu trách nhiệm.

Toner và McCauley nói: “Dựa trên kinh nghiệm của chúng tôi, chúng tôi tin rằng tự quản trị không thể đáng tin cậy để chống lại áp lực của lợi nhuận”.

TechCrunch đưa tin hồi đầu tháng này rằng nhóm Siêu Điều hướng của OpenAI, chịu trách nhiệm phát triển các cách thức để điều khiển các hệ thống AI “siêu thông minh”, được hứa hẹn 20% tài nguyên máy tính của công ty – nhưng hiếm khi nhận được một phần nhỏ của con số đó. Nhóm Siêu Điều hướng kể từ đó đã bị giải thể và phần lớn công việc của họ được giao cho Schulman và một nhóm cố vấn an toàn mà OpenAI thành lập vào tháng 12.

Mặc dù kêu gọi quy định về AI, OpenAI cũng nỗ lực định hình các quy định đó bằng cách thuê một nhóm vận động hành lang nội bộ và các nhà vận động hành lang tại một số công ty luật ngày càng mở rộng, đồng thời chi hàng trăm nghìn đô la cho hoạt động vận động hành lang tại Mỹ chỉ trong quý 4 năm 2023.

Để tránh cáo buộc tô điểm đạo đức cho Ủy ban An toàn và Bảo mật do các giám đốc điều hành thống trị, OpenAI cam kết thuê các chuyên gia “an toàn, bảo mật và kỹ thuật” bên thứ ba để hỗ trợ công việc của ủy ban, bao gồm cựu chiến binh an ninh mạng Rob Joyce và cựu quan chức Bộ Tư pháp Hoa Kỳ John Carlin. Tuy nhiên, ngoài Joyce và Carlin, công ty không tiết lộ chi tiết về quy mô hoặc thành phần của nhóm chuyên gia bên ngoài này – cũng như không làm sáng tỏ những hạn chế về quyền lực và ảnh hưởng của nhóm đối với ủy ban.

Trong một bài đăng trên X, nhà báo Bloomberg Parmy Olson lưu ý rằng các hội đồng giám sát doanh nghiệp như Ủy ban An toàn và Bảo mật, tương tự như các hội đồng giám sát AI của Google như Hội đồng Tư vấn Ngoài về Công nghệ Tiên tiến, hoạt động không hiệu quả trong việc giám sát thực tế. Điều đáng nói là OpenAI cho biết họ đang tìm cách giải quyết “những lời chỉ trích chính đáng” về công việc của mình thông qua ủy ban – “những lời chỉ trích chính đáng” tùy thuộc vào cách nhìn nhận của mọi người.

OpenAI just created an oversight board that’s filled with its own executives and Altman himself. This is a tried and tested approach to self-regulation in tech that does virtually nothing in the way of actual oversight. https://t.co/X7ay4IijXF

— Parmy Olson (@parmy) May 28, 2024

Altman từng hứa rằng những người ngoài cuộc sẽ đóng một vai trò quan trọng trong việc quản trị OpenAI. Trong một bài báo năm 2016 trên tờ New Yorker, ông nói rằng OpenAI sẽ lên kế hoạch một cách để cho phép hầu hết mọi người trên thế giới bầu chọn đại diện vào một hội đồng quản trị. Điều đó đã không bao giờ xảy ra – và có vẻ như nó sẽ không xảy ra tại thời điểm này.

Tin tài trợ

- Vũ trụ

Premium

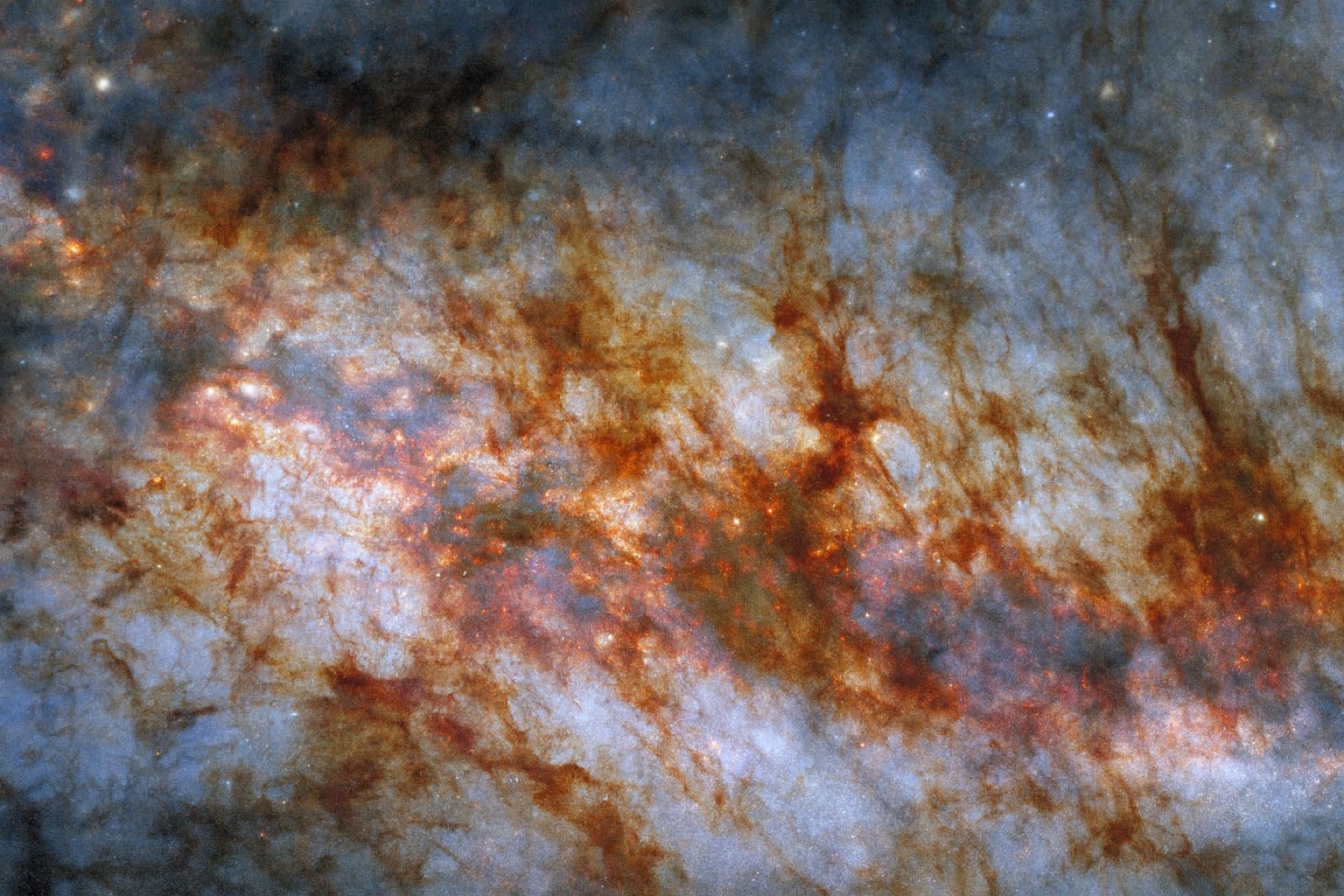

Hubble của NASA và ESA công bố hình ảnh ngoạn mục về lõi thiên hà Xì gà

Bức ảnh mới nhất từ Kính viễn vọng không gian Hubble của NASA và ESA vừa hé lộ những chi tiết chưa từng thấy về thiên hà Messier 82 (M82), nơi hàng triệu ngôi sao rực rỡ đang ẩn mình sau những đám mây bụi và khí với hình thù độc đáo. Bức ảnh mang […] - Thủ thuật

Premium

Lý do màn hình nhấp nháy khi chơi game và cách khắc phục

Hiện tượng màn hình nhấp nháy khi chơi game đã trở thành một nỗi ám ảnh đối với nhiều game thủ, gây khó chịu và ảnh hưởng đáng kể đến trải nghiệm. Theo các chuyên gia công nghệ, nguyên nhân chính của vấn đề này có thể nằm ở chính công nghệ đồng bộ hóa […] - Mobile

Premium

iPhone 17 Pro và iPhone Air vừa ra mắt đã dính lỗi trầy xước

Ngay khi vừa được bày bán tại các Apple Store trên toàn cầu, bộ đôi iPhone 17 Pro và iPhone Air – hai mẫu máy đang nhận được sự quan tâm đặc biệt của cộng đồng công nghệ – đã bắt đầu ghi nhận những phản ánh đầu tiên về hiện tượng trầy xước. Điều […] - Khám phá

Premium

Jimmy Kimmel bị đình chỉ: ‘Văn hóa tẩy chay’ hay áp lực chính trị?

Mới đây, đài truyền hình ABC, thuộc sở hữu của Disney, đã đột ngột đình chỉ chương trình nổi tiếng Jimmy Kimmel Live. Quyết định này được đưa ra ngay sau khi nam MC có một bình luận gây tranh cãi về vụ án mạng liên quan đến Charlie Kirk. Sự việc nhanh chóng trở […]

Bài viết liên quan

Đừng bị Tatao Live lừa đảo

New York chính thức “tuyên chiến” với AI thiếu kiểm soát: Big Tech không thể lách luật?

Thiết bị ‘siêu máy tính AI’ cá nhân của Nvidia sẵn sàng ra mắt thị trường vào 15/10

California thiết lập khung pháp lý cho các ứng dụng chatbot AI

Fan hâm mộ Taylor Swift phản ứng trước nghi vấn cô dùng hình ảnh tạo bởi AI trong chiến dịch quảng bá

Nền tảng ChatGPT của OpenAI chính thức trình làng tính năng tích hợp đa ứng dụng

Nội bộ OpenAI đang đối mặt với những thách thức từ chiến lược truyền thông xã hội mới của công ty

Toyota bổ sung khoản vốn 1,5 tỷ USD, khẳng định niềm tin vào các dự án startup công nghệ

OpenAI công bố mô hình Sora 2 và ứng dụng chia sẻ video, mục tiêu cạnh tranh với Tiktok

Thông tin sai lệch của nền tảng Deepseek AI về chủ quyền biển đảo Việt Nam gây tranh cãi

DeepSeek: Từ A đến Z về ứng dụng trò chuyện AI được giới công nghệ quan tâm

Robot siêu nhỏ “đi bộ trên nước” lấy cảm hứng từ côn trùng nước

Insta360 Wave ra mắt: Loa hội nghị AI có 8 micro, tự động tóm tắt cuộc họp và pin 12 giờ

Meta chính thức ra mắt ‘Vibes’, nền tảng video ngắn chỉ dùng nội dung do AI tổng hợp

Elon Musk ‘hạ giá’ Grok, mời chào Chính phủ Liên bang Mỹ với giá ‘rẻ như cho’

Databricks chi 100 triệu USD, tích hợp mô hình OpenAI vào sản phẩm để thúc đẩy doanh nghiệp ứng dụng

Spotify ban hành quy định mới về dán nhãn âm nhạc do AI sáng tác

Google Cloud đẩy mạnh chiến lược, không ngừng mở rộng phạm vi hoạt động

Gemini 2.5 Deep Think giành huy chương vàng tại ICPC 2025

ĐĂNG KÝ NHẬN TIN

NGAY HÔM NAY

Đăng ký để nhận thông tin sớm nhất về những câu chuyện nóng hổi hiện nay trên thị trường, công nghệ được cung cấp hàng ngày.

Bằng cách nhấp vào “Đăng ký”, bạn chấp nhận Điều khoản dịch vụ và Chính sách quyền riêng tư của chúng tôi. Bạn có thể chọn không tham gia bất cứ lúc nào.

Nhận xét (0)