Micron tăng cường sức mạnh cho chip NVIDIA với HBM3E và SOCAMM thế hệ mới

16:37 29/03/2025

3 phút đọc

Micron, một trong những nhà sản xuất bộ nhớ hàng đầu, đang tăng cường hợp tác với NVIDIA để cung cấp các sản phẩm bộ nhớ hiệu năng cao cho các chip xử lý AI tiên tiến như HGX B300 NVL16 và GB300 NVL72. Tại sự kiện GTC 2025, Micron đã giới thiệu các sản phẩm bộ nhớ mới nhất, bao gồm 12H HBM3E và SOCAMM, nhằm nâng cao hiệu suất và hiệu quả của các nền tảng AI.

Trong bối cảnh nhu cầu về xử lý AI ngày càng tăng, các nhà sản xuất bộ nhớ như Micron, SK Hynix và Samsung đang cạnh tranh để cung cấp các giải pháp bộ nhớ mạnh mẽ nhất cho các chip xử lý đồ họa (GPU) dành cho trung tâm dữ liệu, đặc biệt là dòng Blackwell của NVIDIA. Micron đã chính thức tham gia cuộc đua này bằng việc giới thiệu các sản phẩm bộ nhớ tiên tiến của mình.

Micron hợp tác với NVIDIA để cung cấp bộ nhớ HBM3E 12H và SOCAMM cho các chip hiệu năng cao. Bộ nhớ SOCAMM (small outline compression attached memory module) dựa trên LPDDR5X của Micron sẽ được sử dụng trên siêu chip GB300 Grace Blackwell Ultra của NVIDIA, trong khi bộ nhớ HBM3E 12H 36GB sẽ được sử dụng trên các nền tảng HGX B300 NVL16 và GB300 NVL72.

Đây là những chip Blackwell mới nhất và mạnh mẽ nhất được NVIDIA công bố tại sự kiện GTC. Micron cũng cung cấp chip HBM3E 8H 24GB cho NVIDIA cho các nền tảng HGX B200 và GB200 NVL72. Bộ nhớ HBM3E 12H có 12 die DRAM xếp chồng theo chiều dọc, đạt dung lượng bộ nhớ cao hơn 12GB so với biến thể 8H. Do khối lượng công việc AI đòi hỏi nhiều bộ nhớ, chip bộ nhớ 36GB sẽ tăng đáng kể dung lượng bộ nhớ trên GPU NVIDIA.

So với ngăn xếp HBM3E 8H, tổng dung lượng bộ nhớ tăng 50% với bộ nhớ HBM3E 12H. Điều này cho phép GPU Blackwell Ultra chạy các mô hình lớn hơn và Meta Llama 405B hiện có thể phù hợp trên một GPU duy nhất. Bộ nhớ HBM3E mới không chỉ có dung lượng bộ nhớ và băng thông bộ nhớ cao hơn mà còn tiêu thụ ít hơn 20% điện năng, lý tưởng cho các trung tâm dữ liệu.

SOCAMM dựa trên LPDDR5X là một lựa chọn tuyệt vời cho điện toán hiệu năng cao (HPC). Nó chỉ có kích thước 14x90mm, chiếm gần 1/3 không gian của RDIMM và có thể cung cấp tới 128GB mỗi mô-đun bằng cách sử dụng ngăn xếp 16 die bộ nhớ LPDDR5X. SOCAMM tiết kiệm điện hơn đáng kể so với RDIMM thông thường và cung cấp băng thông gấp hơn 2,5 lần.

Hiện tại, Micron có một danh mục sản phẩm mạnh mẽ bao gồm bộ nhớ GDDR7 (được sử dụng trên GPU NVIDIA Blackwell RTX 50 series), RDIMM và MRDIMM DDR5 dung lượng cao, HBM3E và SOCAMM, cũng như các giải pháp lưu trữ hàng đầu trong ngành như Micron 9550 NVMe và 7450 NVMe SSD. Samsung cũng đã phát hành SSD 9100 PRO hàng đầu của mình với tiêu chuẩn PCI-E 5.0, cung cấp tốc độ đọc tuần tự lên đến 14.800 MB/s.

Sự hợp tác giữa Micron và NVIDIA, cùng với việc ra mắt các sản phẩm bộ nhớ tiên tiến như HBM3E 12H và SOCAMM, đánh dấu một bước tiến quan trọng trong việc phát triển các nền tảng AI hiệu năng cao. Cuộc đua bộ nhớ hiệu năng cao đang diễn ra sôi động, và các nhà sản xuất bộ nhớ đang không ngừng nỗ lực để đáp ứng nhu cầu ngày càng tăng của thị trường AI.

Tin tài trợ

- Vũ trụ

Premium

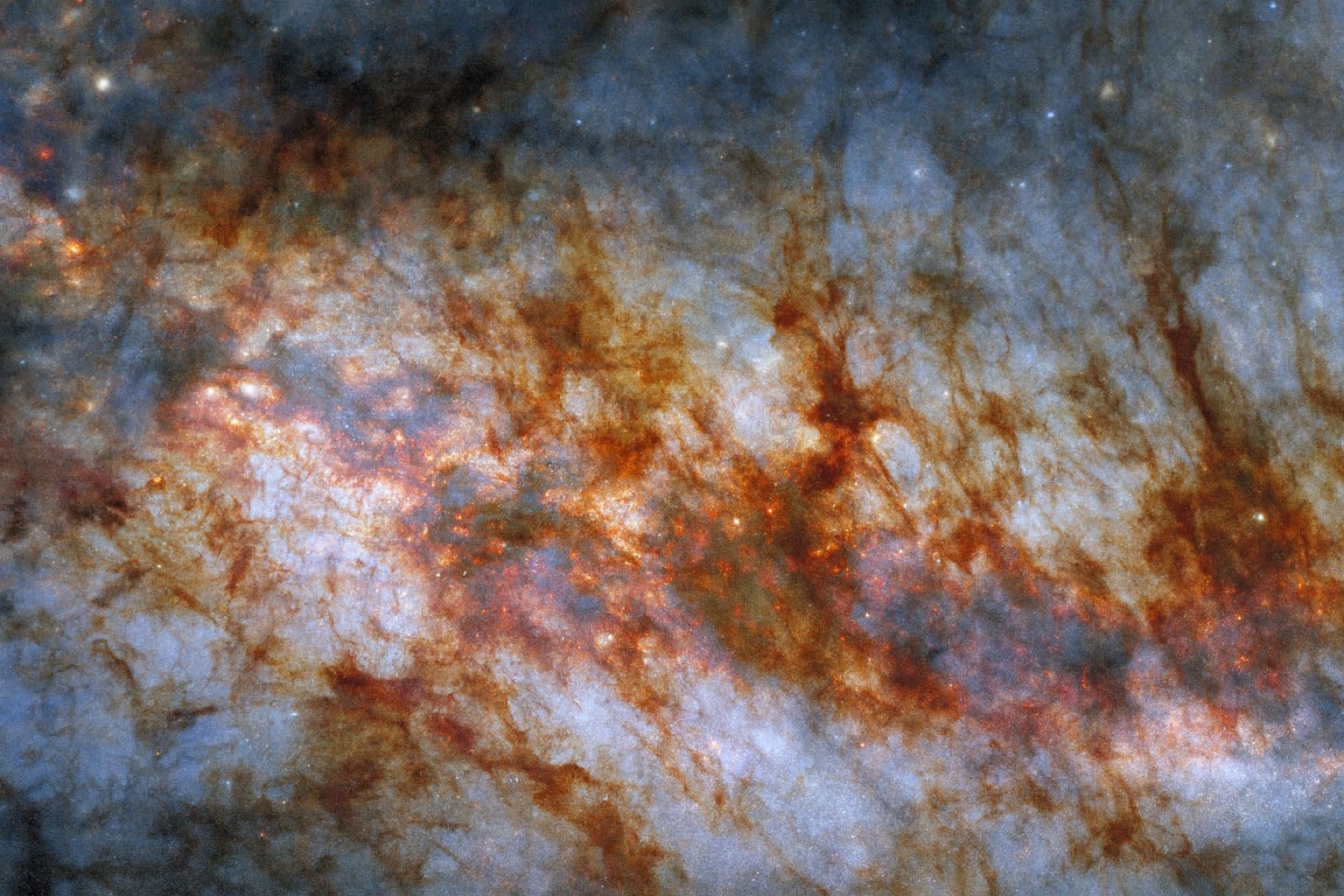

Hubble của NASA và ESA công bố hình ảnh ngoạn mục về lõi thiên hà Xì gà

Bức ảnh mới nhất từ Kính viễn vọng không gian Hubble của NASA và ESA vừa hé lộ những chi tiết chưa từng thấy về thiên hà Messier 82 (M82), nơi hàng triệu ngôi sao rực rỡ đang ẩn mình sau những đám mây bụi và khí với hình thù độc đáo. Bức ảnh mang […] - Thủ thuật

Premium

Lý do màn hình nhấp nháy khi chơi game và cách khắc phục

Hiện tượng màn hình nhấp nháy khi chơi game đã trở thành một nỗi ám ảnh đối với nhiều game thủ, gây khó chịu và ảnh hưởng đáng kể đến trải nghiệm. Theo các chuyên gia công nghệ, nguyên nhân chính của vấn đề này có thể nằm ở chính công nghệ đồng bộ hóa […] - Mobile

Premium

iPhone 17 Pro và iPhone Air vừa ra mắt đã dính lỗi trầy xước

Ngay khi vừa được bày bán tại các Apple Store trên toàn cầu, bộ đôi iPhone 17 Pro và iPhone Air – hai mẫu máy đang nhận được sự quan tâm đặc biệt của cộng đồng công nghệ – đã bắt đầu ghi nhận những phản ánh đầu tiên về hiện tượng trầy xước. Điều […] - Khám phá

Premium

Jimmy Kimmel bị đình chỉ: ‘Văn hóa tẩy chay’ hay áp lực chính trị?

Mới đây, đài truyền hình ABC, thuộc sở hữu của Disney, đã đột ngột đình chỉ chương trình nổi tiếng Jimmy Kimmel Live. Quyết định này được đưa ra ngay sau khi nam MC có một bình luận gây tranh cãi về vụ án mạng liên quan đến Charlie Kirk. Sự việc nhanh chóng trở […]

Bài viết liên quan

Premium

PremiumHubble của NASA và ESA công bố hình ảnh ngoạn mục về lõi thiên hà Xì gà

Premium

PremiumLý do màn hình nhấp nháy khi chơi game và cách khắc phục

Premium

PremiumJimmy Kimmel bị đình chỉ: ‘Văn hóa tẩy chay’ hay áp lực chính trị?

Đừng bị Tatao Live lừa đảo

Vũ khí mới của TikTok Shop trong cuộc chiến giành thị phần với Amazon

New York chính thức “tuyên chiến” với AI thiếu kiểm soát: Big Tech không thể lách luật?

Cẩn thận với Tạp Hóa MMO (taphoammo.net)

Pinterest bị sập toàn cầu, nghi vấn do sự cố từ Amazon Web Services

XP-Pen Artist Ultra 16: Bảng vẽ 4K AMOLED cho dân thiết kế chuyên nghiệp

Robot siêu nhỏ “đi bộ trên nước” lấy cảm hứng từ côn trùng nước

Coros Apex 4: Đối thủ mới của Garmin trong thế giới đồng hồ thể thao GPS?

Vision Mini: Kính “xem TV” di động với màn hình 3.8K, hỗ trợ người cận thị nặng

TASCAM FR-AV4: Cỗ máy ghi âm 4 kênh dành cho phim trường, “chống peak” không cần chỉnh gain

FiiO Snowsky Tiny: DAC nhỏ gọn bằng ngón tay, phát nhạc Hi-Res, sạc nhanh

FiiO FT13: Khi gỗ quý, sợi carbon và âm nhạc Hi-Res gặp nhau trong một kiệt tác tai nghe

GMK NucBox K12: Thiết kế đậm chất riêng, nhưng phần tháo lắp khiến người dùng “cạn lời”

Camera siêu phổ thu nhỏ: Khi điện thoại thông minh “nhìn” được nhiều màu hơn cả mắt người

Oppo Find X9/X9 Pro lộ diện: Thiết kế giống OnePlus 15, xác nhận dùng Dimensity 9500

Hisense ra mắt màn hình gaming G7 Ultra: Mini LED 4K, 2.000 nits

ĐĂNG KÝ NHẬN TIN

NGAY HÔM NAY

Đăng ký để nhận thông tin sớm nhất về những câu chuyện nóng hổi hiện nay trên thị trường, công nghệ được cung cấp hàng ngày.

Bằng cách nhấp vào “Đăng ký”, bạn chấp nhận Điều khoản dịch vụ và Chính sách quyền riêng tư của chúng tôi. Bạn có thể chọn không tham gia bất cứ lúc nào.

Nhận xét (0)