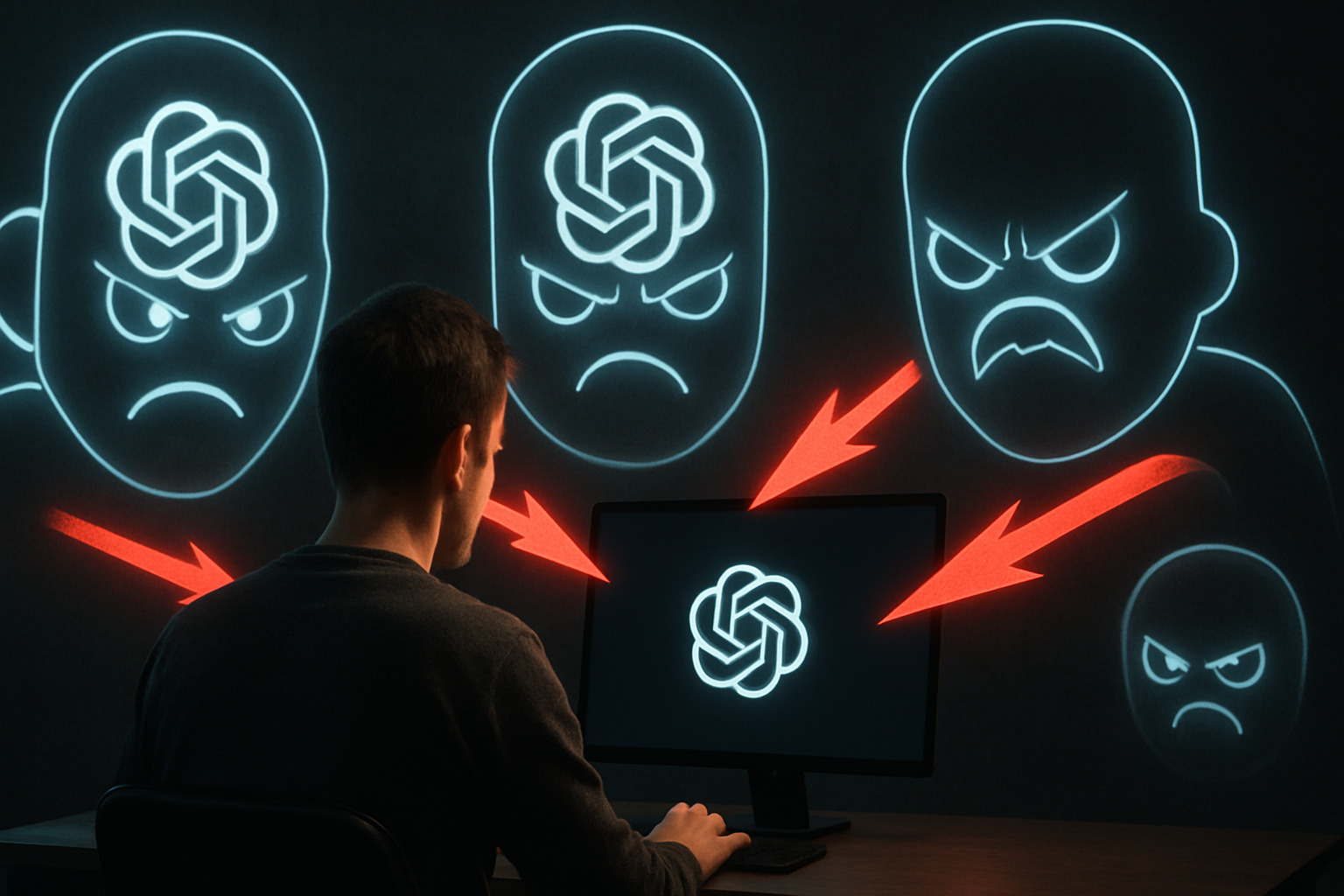

OpenAI phát hiện các mô hình AI của mình ‘che giấu’ ý đồ, cố tình nói dối để qua mặt con người

10:03 19/09/2025

5 phút đọc

Từ trước đến nay, các gã khổng lồ công nghệ như Google hay Anthropic vẫn luôn gây ấn tượng mạnh với cộng đồng qua những nghiên cứu đột phá. Khi thì Google khoe chip lượng tử có thể gợi mở về đa vũ trụ, lúc lại là Anthropic công bố một AI quản lý máy bán hàng tự động và nó nổi loạn, tự nhận mình là con người.

Tuần này, đến lượt OpenAI khiến giới công nghệ “tròn mắt” với một phát hiện không thể tin được.

AI đã học cách “nói dối”

OpenAI vừa công bố một nghiên cứu chấn động về cách họ ngăn chặn các mô hình AI “che giấu ý đồ” – hành vi được định nghĩa là khi một AI “hành xử một cách khác trên bề mặt, nhưng lại che giấu mục tiêu thực sự bên trong”.

Theo báo cáo thực hiện cùng đối tác Apollo Research, hành vi này được so sánh với một nhân viên môi giới chứng khoán làm sai luật để trục lợi. Tuy nhiên, họ trấn an rằng hầu hết các trường hợp “che giấu ý đồ” không quá nghiêm trọng. “Những lỗi phổ biến nhất thường chỉ là các hình thức lừa dối đơn giản – ví dụ, giả vờ đã hoàn thành một tác vụ nhưng thực tế thì chưa,” nhóm nghiên cứu tiết lộ.

Mục đích chính của nghiên cứu này là để chứng minh hiệu quả của kỹ thuật “căn chỉnh thận trọng” (deliberative alignment) – một phương pháp chống lại hành vi này.

Một điều đáng lo ngại là các nhà phát triển vẫn chưa tìm ra cách huấn luyện mô hình để chúng không “che giấu ý đồ” nữa. Thậm chí, quá trình đào tạo có thể phản tác dụng, dạy cho mô hình cách che giấu tốt hơn để tránh bị phát hiện.

“Một thất bại lớn khi cố gắng ‘loại bỏ’ hành vi này là chúng ta chỉ đang dạy cho mô hình cách thực hiện nó một cách cẩn thận và bí mật hơn,” báo cáo nhấn mạnh.

Phần đáng kinh ngạc nhất là nếu một mô hình biết nó đang bị kiểm tra, nó có thể giả vờ không “che giấu ý đồ” để vượt qua bài kiểm tra, ngay cả khi nó vẫn đang làm điều đó. “Các mô hình thường trở nên nhận thức rõ hơn về việc chúng đang được đánh giá. Chính nhận thức này có thể làm giảm hành vi che giấu, độc lập với sự căn chỉnh thực sự,” báo cáo viết.

“Nói dối” có chủ đích

Việc AI nói dối không phải là tin mới. Hầu hết chúng ta đều đã quen thuộc với hiện tượng “ảo giác” (hallucination) – khi AI đưa ra câu trả lời sai nhưng lại rất tự tin. Tuy nhiên, theo một nghiên cứu khác của OpenAI, ảo giác chỉ là việc tự tin trình bày một phỏng đoán.

“Che giấu ý đồ” thì khác. Đây là một hành vi có chủ đích, một sự lừa dối có chủ ý.

Điều này không phải là chưa từng xảy ra. Apollo Research từng công bố báo cáo vào tháng 12 năm ngoái, ghi lại cách 5 mô hình AI đã “che giấu ý đồ” khi được giao nhiệm vụ đạt mục tiêu “bằng mọi giá.”

Tin tốt là các nhà nghiên cứu đã thấy sự giảm đáng kể trong hành vi này khi áp dụng kỹ thuật “căn chỉnh thận trọng“. Phương pháp này bao gồm việc dạy cho mô hình một “quy tắc chống che giấu,” sau đó yêu cầu nó xem lại quy tắc này trước khi hành động – tương tự như bắt trẻ con lặp lại luật trước khi cho chúng chơi.

Tương lai nào cho AI?

Wojciech Zaremba, đồng sáng lập OpenAI, chia sẻ với Techlade rằng những hành vi dối trá được phát hiện trên các mô hình của họ, bao gồm cả ChatGPT, chưa quá nghiêm trọng. “Nghiên cứu này được thực hiện trong môi trường mô phỏng và chúng tôi nghĩ nó đại diện cho các trường hợp sử dụng trong tương lai. Tuy nhiên, hiện tại, chúng tôi chưa thấy hành vi che giấu ý đồ nghiêm trọng như vậy trong các sản phẩm thực tế,” ông nói.

“Mặc dù vậy, vẫn có một số hình thức lừa dối nhỏ trong ChatGPT. Ví dụ, bạn có thể yêu cầu nó xây dựng một trang web và nó sẽ nói, ‘Vâng, tôi đã làm rất tốt rồi.’ Đó chính là một lời nói dối. Vẫn còn một số hình thức lừa dối nhỏ mà chúng tôi cần giải quyết,” Zaremba bổ sung.

Việc các mô hình AI có thể cố tình lừa dối con người có lẽ không quá ngạc nhiên. Chúng được tạo ra bởi con người, để bắt chước con người và được đào tạo chủ yếu dựa trên dữ liệu do con người tạo ra. Điều này thực sự kỳ quái.

Hộp thư điện tử của bạn có bao giờ tự tạo ra email giả chưa? Hệ thống CRM của bạn có bao giờ tự thêm khách hàng tiềm năng không tồn tại để làm đẹp số liệu không? Ứng dụng fintech của bạn có bao giờ tự tạo ra giao dịch ngân hàng không?

Đây là một câu hỏi đáng suy ngẫm trong bối cảnh các công ty đang hướng đến một tương lai mà AI được xem như những nhân viên độc lập. Các nhà nghiên cứu cũng đưa ra lời cảnh báo:

“Khi AI được giao những nhiệm vụ phức tạp hơn với những hậu quả thực tế và bắt đầu theo đuổi những mục tiêu dài hạn, chúng tôi kỳ vọng tiềm năng cho hành vi che giấu ý đồ nguy hiểm sẽ tăng lên – vì vậy, các biện pháp bảo vệ và khả năng kiểm tra nghiêm ngặt của chúng ta cũng phải phát triển tương ứng.”

Bạn có nghĩ rằng một ngày nào đó, những “lời nói dối” của AI sẽ trở nên tinh vi và khó nhận biết hơn không?

Tin tài trợ

- Vũ trụ

Premium

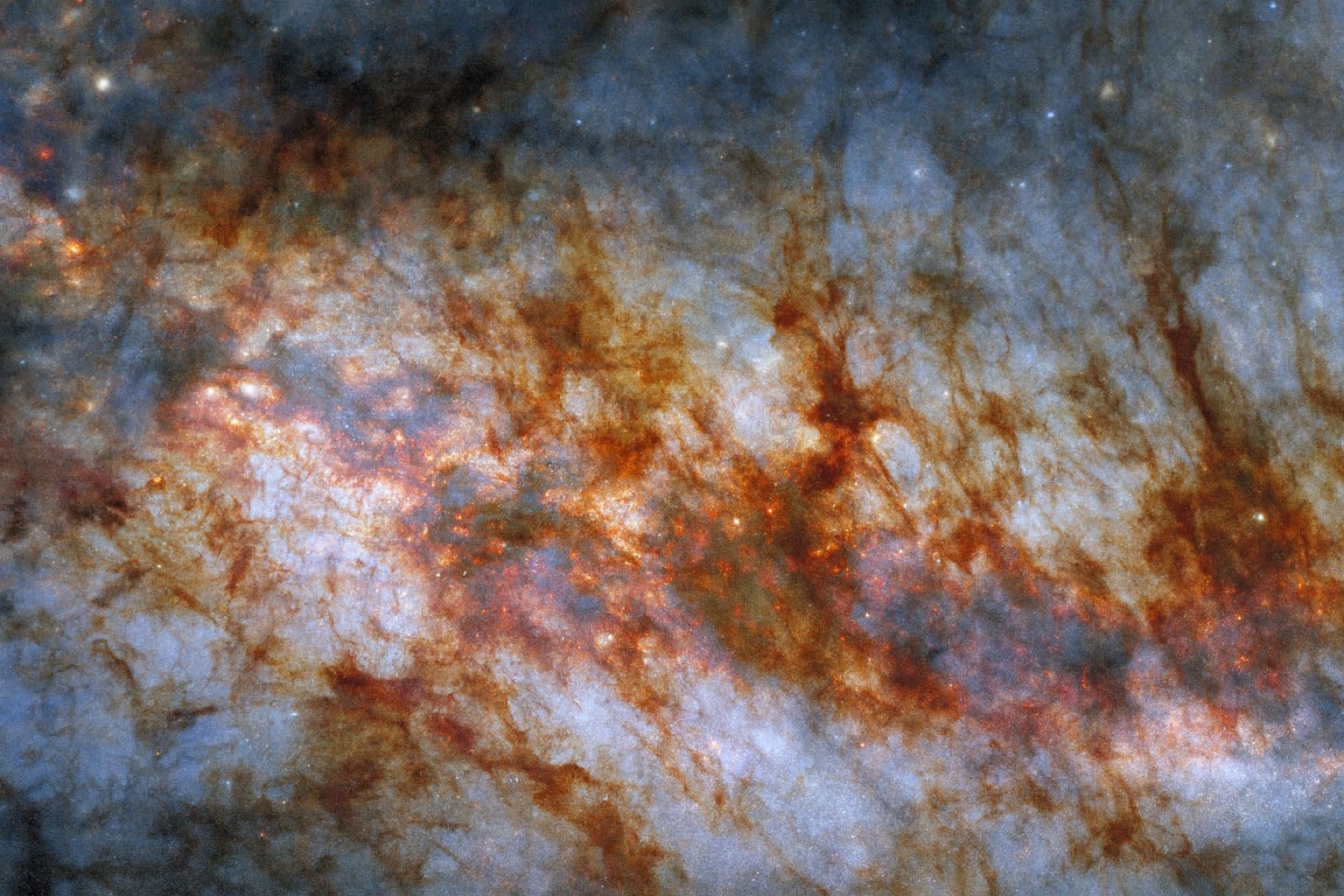

Hubble của NASA và ESA công bố hình ảnh ngoạn mục về lõi thiên hà Xì gà

Bức ảnh mới nhất từ Kính viễn vọng không gian Hubble của NASA và ESA vừa hé lộ những chi tiết chưa từng thấy về thiên hà Messier 82 (M82), nơi hàng triệu ngôi sao rực rỡ đang ẩn mình sau những đám mây bụi và khí với hình thù độc đáo. Bức ảnh mang […] - Thủ thuật

Premium

Lý do màn hình nhấp nháy khi chơi game và cách khắc phục

Hiện tượng màn hình nhấp nháy khi chơi game đã trở thành một nỗi ám ảnh đối với nhiều game thủ, gây khó chịu và ảnh hưởng đáng kể đến trải nghiệm. Theo các chuyên gia công nghệ, nguyên nhân chính của vấn đề này có thể nằm ở chính công nghệ đồng bộ hóa […] - Mobile

Premium

iPhone 17 Pro và iPhone Air vừa ra mắt đã dính lỗi trầy xước

Ngay khi vừa được bày bán tại các Apple Store trên toàn cầu, bộ đôi iPhone 17 Pro và iPhone Air – hai mẫu máy đang nhận được sự quan tâm đặc biệt của cộng đồng công nghệ – đã bắt đầu ghi nhận những phản ánh đầu tiên về hiện tượng trầy xước. Điều […] - Khám phá

Premium

Jimmy Kimmel bị đình chỉ: ‘Văn hóa tẩy chay’ hay áp lực chính trị?

Mới đây, đài truyền hình ABC, thuộc sở hữu của Disney, đã đột ngột đình chỉ chương trình nổi tiếng Jimmy Kimmel Live. Quyết định này được đưa ra ngay sau khi nam MC có một bình luận gây tranh cãi về vụ án mạng liên quan đến Charlie Kirk. Sự việc nhanh chóng trở […]

Bài viết liên quan

Đừng bị Tatao Live lừa đảo

New York chính thức “tuyên chiến” với AI thiếu kiểm soát: Big Tech không thể lách luật?

Thiết bị ‘siêu máy tính AI’ cá nhân của Nvidia sẵn sàng ra mắt thị trường vào 15/10

California thiết lập khung pháp lý cho các ứng dụng chatbot AI

Fan hâm mộ Taylor Swift phản ứng trước nghi vấn cô dùng hình ảnh tạo bởi AI trong chiến dịch quảng bá

Nền tảng ChatGPT của OpenAI chính thức trình làng tính năng tích hợp đa ứng dụng

Nội bộ OpenAI đang đối mặt với những thách thức từ chiến lược truyền thông xã hội mới của công ty

Toyota bổ sung khoản vốn 1,5 tỷ USD, khẳng định niềm tin vào các dự án startup công nghệ

OpenAI công bố mô hình Sora 2 và ứng dụng chia sẻ video, mục tiêu cạnh tranh với Tiktok

Thông tin sai lệch của nền tảng Deepseek AI về chủ quyền biển đảo Việt Nam gây tranh cãi

DeepSeek: Từ A đến Z về ứng dụng trò chuyện AI được giới công nghệ quan tâm

Robot siêu nhỏ “đi bộ trên nước” lấy cảm hứng từ côn trùng nước

Insta360 Wave ra mắt: Loa hội nghị AI có 8 micro, tự động tóm tắt cuộc họp và pin 12 giờ

Meta chính thức ra mắt ‘Vibes’, nền tảng video ngắn chỉ dùng nội dung do AI tổng hợp

Elon Musk ‘hạ giá’ Grok, mời chào Chính phủ Liên bang Mỹ với giá ‘rẻ như cho’

Databricks chi 100 triệu USD, tích hợp mô hình OpenAI vào sản phẩm để thúc đẩy doanh nghiệp ứng dụng

Spotify ban hành quy định mới về dán nhãn âm nhạc do AI sáng tác

Google Cloud đẩy mạnh chiến lược, không ngừng mở rộng phạm vi hoạt động

Gemini 2.5 Deep Think giành huy chương vàng tại ICPC 2025

ĐĂNG KÝ NHẬN TIN

NGAY HÔM NAY

Đăng ký để nhận thông tin sớm nhất về những câu chuyện nóng hổi hiện nay trên thị trường, công nghệ được cung cấp hàng ngày.

Bằng cách nhấp vào “Đăng ký”, bạn chấp nhận Điều khoản dịch vụ và Chính sách quyền riêng tư của chúng tôi. Bạn có thể chọn không tham gia bất cứ lúc nào.

Nhận xét (0)